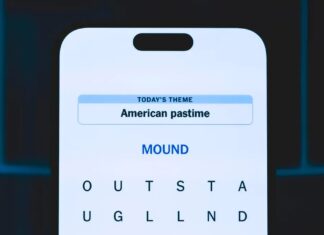

En un seminario ejecutivo reciente, una estudiante ofreció una idea provocativa: utiliza chatbots de IA como “adivinadores”. Afirmó que, al igual que leer las hojas de té, la IA puede proporcionar vislumbres sorprendentemente precisas del futuro, y citó un caso reciente en el que predijo correctamente un aumento del 2% en el mercado de valores.

Si bien esto puede parecer una novedad inofensiva, afecta a un cambio profundo y peligroso en el funcionamiento de la sociedad. Nos estamos alejando de los métodos tradicionales de pronóstico (astronomía, sociología o economía) y entregando las claves del futuro a una nueva clase de adivinos: informáticos, analistas de datos e ingenieros.

Зміст

La confusión entre predicción y hecho

Hay un error lógico fundamental en el centro de nuestra obsesión moderna por la tecnología predictiva: las predicciones no son hechos.

Los hechos pertenecen estrictamente al presente y al pasado. Por definición, el futuro no ha sucedido; por lo tanto, no hay hechos al respecto. Una afirmación sobre lo que podría suceder puede ser una estimación, una advertencia o un deseo, pero nunca puede ser una verdad fáctica.

Cuando tratamos los resultados de la IA como “verdad”, caemos en una trampa peligrosa. Comenzamos a confundir las probabilidades estadísticas con realidades inevitables, olvidando que estos modelos simplemente calculan el siguiente paso más probable basándose en patrones históricos.

La fantasía del “demonio de Laplace”

El impulso detrás de la IA moderna está impulsado por una fantasía científica conocida como El demonio de Laplace. Propuesto por Pierre-Simon Laplace, el concepto sugiere que si una inteligencia poseyera un conocimiento completo de la posición y el impulso de cada partícula del universo, el futuro sería tan visible como el pasado. Desde este punto de vista, la incertidumbre es simplemente una falta de datos.

Los defensores de la IA moderna persiguen este sueño mediante la “fuerza bruta”. La lógica sigue un ciclo implacable:

1. Recopile todo: Realice un seguimiento de cada movimiento, compra, interacción social y métrica biológica.

2. Procese todo: Utilice una potencia computacional masiva para analizar estos puntos de datos.

3. Predice todo: Utiliza los patrones resultantes para eliminar la incertidumbre.

Esto ha convertido la existencia humana en una mercancía a la que hay que “torturar” para obtener datos. Estamos siendo cuantificados en cada faceta de la vida, desde nuestros patrones de sueño hasta nuestras inclinaciones políticas, todo para alimentar el hambre de precisión predictiva de la máquina.

Aprendizaje automático: un triunfo de la escala, no de la ciencia

Quizás la realidad más aleccionadora de la revolución de la IA es que no fue impulsada por una chispa repentina del genio humano ni por un avance fundamental en la comprensión de cómo funciona la mente. En cambio, como señala el profesor de Oxford Michael Wooldridge, fue una victoria de escala sobre la ciencia.

Durante décadas, las redes neuronales lucharon por producir resultados significativos. El “gran avance” que lo cambió todo no fue una nueva forma de pensar, sino la llegada de:

– Conjuntos de datos masivos: El gran volumen de información digital disponible.

– Cómputo aumentado: La potencia del hardware (GPU) para procesar esa información.

El aprendizaje automático es esencialmente “predicción con esteroides”. Cuando un modelo de lenguaje escribe una oración, no está “pensando”; está prediciendo la siguiente palabra estadísticamente más probable basándose en miles de millones de ejemplos anteriores. Cuando un algoritmo reconoce una cara, simplemente calcula la probabilidad de que ciertos píxeles coincidan con un patrón aprendido.

El costo oculto del “oráculo”

Debido a que estos modelos predictivos requieren inmensos recursos, su desarrollo está indisolublemente ligado al poder y la explotación. El método de “fuerza bruta” utilizado para construir estos sistemas se ha basado en:

– La vigilancia masiva de las poblaciones globales.

– La explotación de trabajadores vulnerables para etiquetar datos.

– Un consumo masivo de recursos naturales.

– La recolección no autorizada de propiedad intelectual.

Además, el auge de los mercados de predicción (como Polymarket) ha convertido el sufrimiento humano y la inestabilidad política en una forma de especulación gamificada. Cuando apostamos por el resultado de guerras o desastres naturales, deshumanizamos a las víctimas y tratamos las crisis del mundo real como meros datos con fines de lucro.

Conclusión

El peligro de la predicción de la IA radica en su capacidad de hacerse pasar por una verdad objetiva y al mismo tiempo actuar como una herramienta de control. Las predicciones no sólo describen el futuro; lo moldean inclinando el comportamiento social hacia el resultado previsto.

En última instancia, debemos reconocer que los algoritmos no son oráculos de la verdad, sino instrumentos de poder, y quienes controlan los datos controlan la dirección del mundo.