Auf der jüngsten Google Cloud Next-Konferenz kündigte Google einen großen strategischen Wandel an: den Schritt über einfache KI-Assistenten hinaus hin zu einer Zukunft, die durch „agentische KI“ definiert wird. Das Unternehmen stellte eine Reihe von Updates vor, die die Arbeitsweise von Unternehmen verändern sollen, wobei der Schwerpunkt auf autonomen Agenten und der enormen Rechenleistung liegt, die für deren Betrieb erforderlich ist.

Der Aufstieg des „Agentenunternehmens“

Während Google berichtet, dass 75 % seiner Kunden bereits KI nutzen, möchte das Unternehmen über die grundlegende Integration in Tools wie Gmail oder Docs hinausgehen. Das neue Ziel ist die Schaffung des „Agentenunternehmens“.

Im Gegensatz zur Standard-KI, die ständige menschliche Eingaben erfordert, bezieht sich agentische KI auf autonome Bots, die in der Lage sind, komplexe, mehrstufige Aufgaben mit minimaler Aufsicht zu erledigen. Dies stellt eine bedeutende Entwicklung in der Branche dar:

– Vom Assistenten zum Akteur: Anstatt nur eine E-Mail zu schreiben, kann ein Agent einen Arbeitsablauf verwalten, zwischen verschiedenen Softwareanwendungen koordinieren und Aufgaben unabhängig ausführen.

– Branchentrend: Dies folgt einer breiteren Bewegung unter Technologieführern – darunter OpenAI und Anthropic –, KI von einem Konversationstool in eine funktionale Belegschaft umzuwandeln, die in der Lage ist, Codierungs- und Verwaltungsprozesse abzuwickeln.

Aufbau der Infrastruktur: Gemini Enterprise Agents

Um diesen Wandel zu bewältigen, führt Google Cloud die Enterprise-Agent-Plattform Gemini ein. Dies dient als zentraler Nervenmotor für Unternehmen und ermöglicht es ihnen, verschiedene KI-Agenten zu überwachen und zu koordinieren.

Zu den Hauptmerkmalen dieses Rollouts gehören:

– Die Gemini Enterprise App: Eine spezielle Schnittstelle für Mitarbeiter zur Interaktion mit und zum Einsatz von KI.

– Neuer Agenten-Designer: Ein Tool, mit dem Benutzer Agenten erstellen und planen können, die Aufgaben über mehrere verschiedene Geschäftsanwendungen hinweg ausführen können.

– Sicherheit und Integration: CEO Thomas Kurian betonte, dass sich diese Aktualisierungen darauf konzentrieren, sicherzustellen, dass Agenten sicher mit den internen Datensystemen eines Unternehmens verbunden sind, und gleichzeitig Kosten und Leistung zu optimieren.

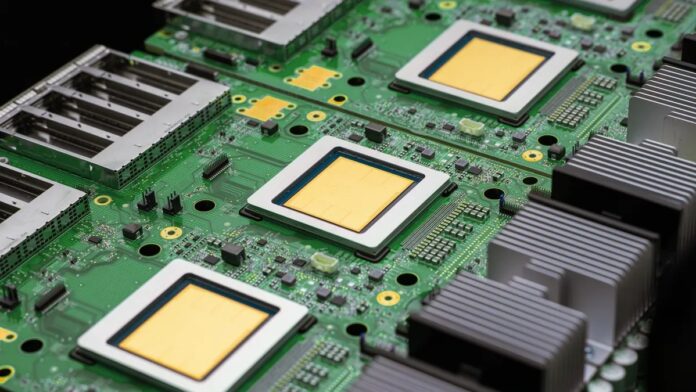

Antrieb für die Zukunft: Die TPUs der 8. Generation

Autonome Agenten erfordern eine enorme Rechenleistung. Um dieser Nachfrage gerecht zu werden, kündigte Google zwei neue Tensor Processing Units (TPUs) der achten Generation an, die speziell für hochintensive KI-Arbeitslasten entwickelt wurden.

Im Gegensatz zu Allzweckprozessoren sind diese Chips auf die schwere Arbeit künstlicher Intelligenz spezialisiert:

1. Der 8T-Chip (Training)

Der 8T-Chip wurde für die „Lernphase“ der KI entwickelt und soll das Training großer Modelle effizienter machen. Google gibt an, dass es die dreifache Rechenleistung seines Vorgängers, des Ironwood der siebten Generation, bietet.

2. Der 8I-Chip (Inferenz)

Der 8I-Chip wurde für die „Ausführungsphase“ entwickelt – wenn eine KI tatsächlich auf einen Benutzer reagiert – und konzentriert sich auf Geschwindigkeit und Speicher. Es verfügt über eine 80 %ige Verbesserung der SRAM-Speicherkapazität und kann in riesige Systeme mit über 11.000 Chips skaliert werden.

Zusammenfassung: Google versucht, die Lücke zwischen KI-Potenzial und Unternehmensrealität zu schließen, indem es sowohl die autonome Software (Gemini-Agenten) als auch die spezialisierte Hardware (TPUs der 8. Generation) bereitstellt, die für eine vollständig automatisierte digitale Belegschaft erforderlich sind.